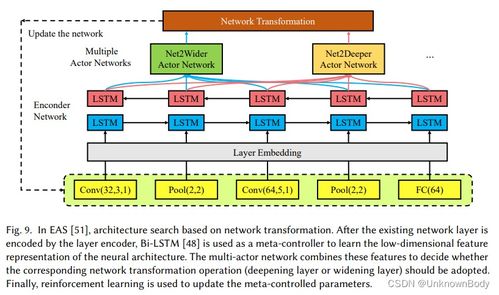

神經(jīng)架構(gòu)搜索(Neural Architecture Search,NAS)是人工智能領(lǐng)域的關(guān)鍵研究方向,旨在自動化設(shè)計神經(jīng)網(wǎng)絡(luò)架構(gòu),以減少人工設(shè)計的工作量并提升模型性能。NAS 面臨多重挑戰(zhàn),包括計算資源消耗巨大、搜索空間設(shè)計復(fù)雜、性能評估效率低下以及泛化能力不足等。針對這些挑戰(zhàn),研究者們提出了一系列解決方案。例如,權(quán)重共享和一次性架構(gòu)搜索方法顯著降低了計算成本;基于強化學(xué)習(xí)、進化算法和梯度優(yōu)化的搜索策略提高了搜索效率;多目標優(yōu)化和可轉(zhuǎn)移性設(shè)計則增強了架構(gòu)的泛化性能。NAS 的發(fā)展方向可能包括與自監(jiān)督學(xué)習(xí)、元學(xué)習(xí)等技術(shù)的結(jié)合,以及在邊緣計算和資源受限環(huán)境中的實際應(yīng)用。本文綜述了 NAS 的核心挑戰(zhàn)、主流解決方案及未來趨勢,為相關(guān)研究提供參考。

神經(jīng)架構(gòu)搜索的挑戰(zhàn)與解決方案 一項全面綜述

更新時間:2026-04-17 13:10:38

如若轉(zhuǎn)載,請注明出處:http://www.glscs.cn/product/36.html

PRODUCT

產(chǎn)品列表

-

更新時間:2026-04-17 17:21:54